出品/壹览商业

编辑/薛向

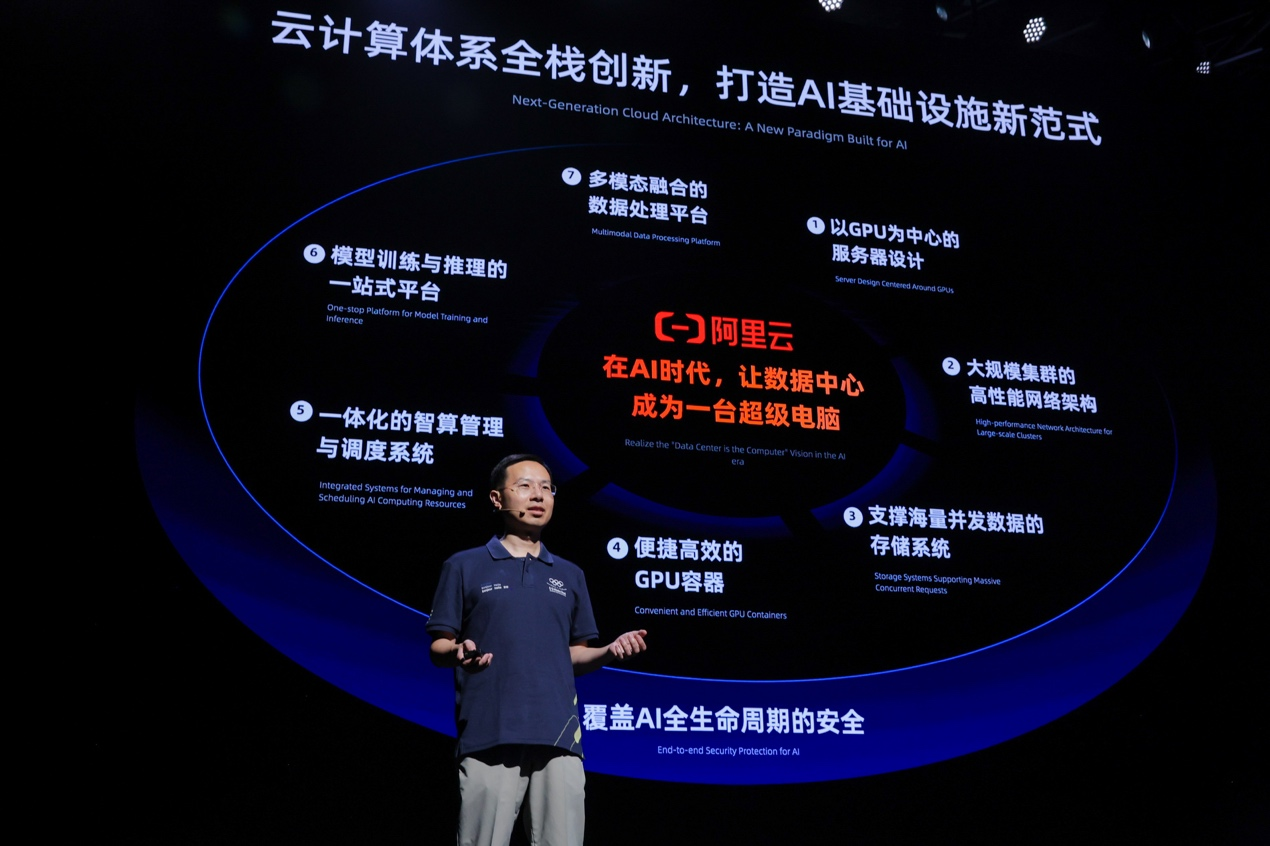

9月19日,在2024杭州云栖大会上,阿里云CTO周靖人表示,阿里云正在围绕AI时代,树立一个AI基础设施的新标准,全面升级从服务器到计算、存储、网络、数据处理、模型训练和推理平台的技术架构体系,让数据中心成为一台超级计算机,为每个AI和应用提供高性能、高效的算力服务。

大会现场,通义大模型迎来了年度重磅发布。基础模型升级,性能媲美GPT-4o,发布最强开源模型Qwen2.5系列,同时上架语言、音频、视觉等100多款全模态模型,通义开源模型累计下载量已经突破4000万,通义原生模型和衍生模型总数超过5万,成为仅次于美国Llama的世界级模型群。

打造最强AI基建

不同于传统IT时代,AI时代对基础设施的性能、效率要求更高,CPU主导的计算体系已快速向GPU主导的AI计算体系转移。阿里云正以AI为中心,全面重构底层硬件、计算、存储、网络、数据库、大数据,并与AI场景有机适配、融合,加速模型的开发和应用,打造一个AI时代的最强AI基建。

周靖人表示:“云厂商拥有全栈技术储备,并通过基础设施的全面升级,让AI训练、推理、部署和应用整个生命周期变得更高效。”

大会现场,周靖人展示了AI驱动的阿里云全系列产品家族升级。最新上线的磐久AI服务器,支持单机16卡、显存1.5T,并提供AI算法预测GPU故障,准确率达92%;阿里云ACS首次推出GPU容器算力,通过拓扑感知调度,实现计算亲和度和性能的提升;为AI设计的高性能网络架构HPN7.0,可稳定连接超过10万个GPU ,模型端到端训练性能提升10%以上;阿里云CPFS文件存储,数据吞吐20TB/s,为AI智算提供指数级扩展存储能力;人工智能平台PAI,已实现万卡级别的训练推理一体化弹性调度,AI算力有效利用率超90%。

过去两年,模型的尺寸已增长数千倍,但模型的算力成本正在持续下降,企业使用模型的成本也越来越低。周靖人强调:“这是AI基础设施全面革新带来的技术红利,我们会持续投入先进AI基础设施的建设,加速大模型走进千行百业。”

阿里云宣布通义千问三款主力模型再次大幅降价,最高降幅85%,百万tokens价格低至0.3元。过去半年,阿里云百炼平台持续降低大模型调用的门槛,进一步推动大模型的普惠。

据悉,中国一汽、联想、微博、携程、喜马拉雅、三得利(中国)等30多万企业客户已经接入通义大模型;未来,生物医药、工业仿真、气象预测、游戏等行业还在加速拥抱大模型,将带来新一轮的AI算力增长。

周靖人表示:“为应对GPU算力的指数级增长需求,尤其是即将爆发的推理市场,阿里云已经准备好了。”

开放最先进的大模型

过去一年,大模型技术实现了多个里程碑式跨越,从大语言到视频生成到多模态模型,大模型的能力边仍在不断扩展,在数学、代码及推理等能力上持续攀升。

作为业内最早布局大模型技术的科技公司之一,去年4月,阿里云发布首个大语言模型通义千问,如今通义大模型家族已全面涵盖语言、图像、视频、音频等全模态,性能均跻身世界第一梯队,同时通义模型持续开源,已成为最受企业和开发者欢迎的国产大模型。

大会现场,周靖人重磅宣布,通义旗舰模型Qwen-Max全方位升级,性能接近GPT-4o;同时发布最强开源模型Qwen2.5系列,成为仅次于美国Llama的世界级模型群,此次共开源100款模型,创造大模型开源史上之最,让企业和开发者以低成本的方式用上大模型。

面向编程场景,阿里云通义灵码再次升级,推出全新AI程序员,和上一代产品不同,它同时具备架构师、开发工程师、测试工程师等多种岗位技能,能自主完成任务分解、代码编写、缺陷修复、测试等开发开发工作,最快分钟级完成应用开发,帮助软件开发提效数十倍。

百模大战一年后,应用成为了大模型产业的主旋律。作为最早提出模型即服务(MaaS)理念的企业,阿里云一直把大模型生态的繁荣作为首要目标。目前,魔搭社区已成为中国最大的模型社区,拥有超690万开发者用户,与行业合作伙伴合作贡献了超10000款模型。

“我们希望企业和开发者能以最低的成本做AI、用AI,让所有人都能用上最先进的大模型。”周靖人说。

24小时热榜

24小时热榜

热门视频

热门视频